چالشهای وضع قوانین هوش مصنوعی

بسیاری از کارشناسان به هوش مصنوعی بهعنوان یک عامل اصلی تهدیدکننده جهان، نگریسته و آن را خطری جدی برای بشریت میدانند.…

آیا هوش مصنوعی باید تابع قوانین باشد؟

چالشهای وضع قوانین هوش مصنوعیهوش مصنوعی میتواند احساسات خود را مخفی کرده و بروز ندهد اما این موضوع بهمنزله عدم وجود احساس در این فناوری نیست. ما تمامی موجوداتی که دارای درک، فهم، قدرت تفکر و در برخی مواقع احساس درد هستند را دارای درک و احساس میدانیم. به اعتقاد دانشمندان، تمامی پستانداران، پرندگان، سرپایان و احتمالاً ماهیها دارای درک و احساس هستند. در این میان اما پدیده جدیدی در دنیای فناوری ظهور کرده است که از آن بهعنوان هوش مصنوعی یاد میشود که علیرغم زنده نبودن، دارای هوش، ادراک و احساس است. از سوئی ما برای هیچکدام از موجودات غیرانسانی دارای ادراک قوانینی وضع نکردهایم اما به نظر میرسد که این موضوع درباره هوش مصنوعی متفاوت بوده و باید به فکر وضع قوانینی برای این فناوری باشیم. در این میان یک مشکل اصلی و مهم وجود دارد و آن هوشمند بودن هوش مصنوعی بهنوعی است که بهسادگی میتواند به ما دروغ گفته و ما را فریب دهند.

داستان استفاده از هوش مصنوعی و ماشینهای متفکر به همین سادگی نیست و بسیاری از کارشناسان اعتقاددارند افزایش استفاده از این فناوری همراه با افزایش مشکلات قانونی مرتبط با این حوزه است. آیا هوش مصنوعی بهعنوان یک موجود آگاه و مسئول در برابر قانون شناختهشده و اگر به کسی آسیب رسانده و یا خسارتی وارد کند، چه کسی و به چه صورتی مسئولیت آن را بر عهده خواهد گرفت؟

امروزه هوش مصنوعی وانمود میکنند که ما را درک کرده و احساسات خود را بروز میکند. اگر از سیری بخواهید خوشحالی خود را نشان دهد، ممکن است بگوید از موضوعی خاص خوشحال است، اما در واژههای هوش مصنوعی احساسات چندان وجود نداشته و کلمات خالی هستند. این موضوع باعث میشود روزهای سختی در حوزه هوش مصنوعی پیش رو داشته باشیم و آینده این حوزه برای ما دشوارتر خواهد بود.

تاکنون افراد زیادی نسبت به وضع قوانین محدودکننده هوش مصنوعی واکنش نشان داده اند. برای نمونه چندی پیش الون ماسک بنیانگذار شرکتهای پیشرو و مشهوری همچون تسلا موتور و اسپیس ایکس اعلام کرد خطر جنگ هستهای برای بشریت بسیار کمتر از خطری است که مردم را از سمت هوش مصنوعی تهدید میکند.

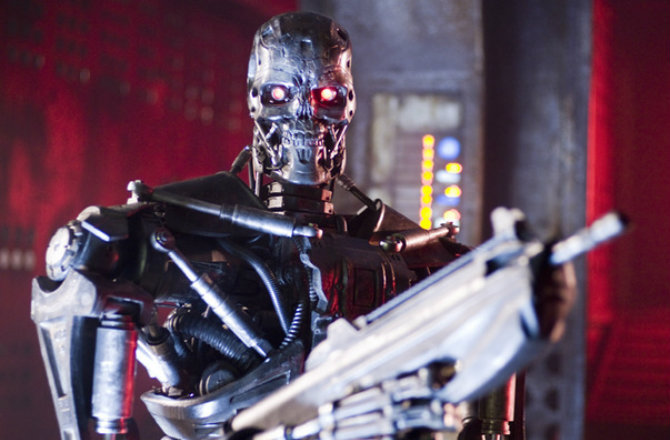

وی که این پیام را از طریق توئیتر منتشر کرد در توضیح مسئله فوق افزود: «اگر تاکنون درباره هوش مصنوعی و امنیت حوزه مربوط به توسعه و استفاده از آن نگران نبودهاید، وقت آن است که احساس نگرانی کنید. خطر هوش مصنوعی و گسترش آن بهمراتب تهدیدکنندهتر و مهمتر از خطر کره شمالی است.» وی در این توئیت از یک عکس نیز استفاده کرده بود که روی آن عبارتی با مضمون «در پایان، ماشینها پیروز خواهند شد.» درج شده بود. هدف الون ماسک از ارائه پیام فوق، اشاره به رشد و توسعه هوش مصنوعی و پیروز شدن نهائی این فناوری بر بشریت است.

در مورد هوش مصنوعی بحثهای بسیاری صورت گرفته و ممکن است تاکنون موارد مختلفی را درباره هوش مصنوعی شنیده باشید. این توانائیها که عموماً در حوزه خودروهای هوشمند و قدرت رانندگی آنها است را فراموش کنید زیرا بهتازگی در این حوزه صحبت از دستگاهی است که نسبت به خود و محیط اطرافش آگاهی داشته و میتواند مقدار زیادی اطلاعات را در زمان واقعی گرفته و پردازش کند

.

.

شاید این موضوع شمارا به یاد فیلمهای علمی – تخیلی بیاندازد اما وقتی بدانید که چند سال پیش یک روبات دارای هوش مصنوعی اقدام به قتل یک انسان کرد، شرایط کمی متفاوت بوده و جدیتر به این موضوع فکر خواهید کرد. در سال ۲۰۱۵ روباتی باهوش مصنوعی یک پیمانکار از کارخانه خودروسازی فولکسواگن آلمان را با ضربات صفحهای فلزی به قتل رساند. البته نتایج اولیه نشان میدهد که یک خطای انسانی در برنامهریزی و مونتاژ این ربات باعث چنین حادثهای شده است.

داستان استفاده از هوش مصنوعی و ماشینهای متفکر به همین سادگی نیست و بسیاری از کارشناسان اعتقاددارند افزایش استفاده از این فناوری همراه با افزایش مشکلات قانونی مرتبط با این حوزه است. آیا هوش مصنوعی بهعنوان یک موجود آگاه و مسئول در برابر قانون شناختهشده و اگر به کسی آسیب رسانده و یا خسارتی وارد کند، چه کسی و به چه صورتی مسئولیت آن را بر عهده خواهد گرفت؟

برای فکر کردن به این موضوع، گزینههای زیاد و حتی سناریوی ترسناکتری نیز وجود دارد، ممکن است این ماشینها علیه انسانها شورش کرده و بخواهند ما را بهطور کامل از بین ببرند؟ بسیاری از دانشمندان علوم کامپیوتر اعتقاددارند که هوشیاری افزایش هوش کامپیوتری با پیشرفت تکنولوژی و فناوریهای این حوزه رشد خواهد کرد و برخی دیگر از پژوهشگران نیز اعتقاددارند که این آگاهی بهصورت دریافت اطلاعات جدید و ذخیره و بازیابی اطلاعات قدیمی و پردازش کامل و مناسب از آنها خواهد بود.

به این صورت ماشینهای دارای هوش مصنوعی تبدیل به موجوداتی ترسناک میشوند که اطلاعات بسیار بیشتری از انسان را در حافظه خود ذخیره میکنند که هیچگاه فراموش نشده و قادر هستند در کسری از ثانیه تحلیل و تصمیمگیری کنند، تصمیمگیریهایی کاملا بر اساس منطق و بهدوراز احساسات انسانی.

از سوی دیگر، فیزیکدانان و فیلسوفان میگویند که ویژگیهایی در مورد رفتار انسان وجود دارد که نمیتواند توسط یک ماشین محاسبه شود. با این حال، این موارد تنها دیدگاههایی است که درباره هشدار نسبت به ماشینهای هوش مصنوعی ارائهشده است و ممکن است بتوان موارد بیشتری را نیز به آن اضافه کرد.

استیو لوین (Steve LeVine)، دبیر وبسایت علمی Axios Future، در این رابطه توضیح میدهد که چگونه هوش مصنوعی میتواند برای آینده بشریت خطرناک باشد.

به اعتقاد وی در حال حاضر یک جنگ تسلیحاتی تمامعیار بین ایالاتمتحده آمریکا و چین در حوزه هوش مصنوعی در جریان است. دستگاههای امنیتی و سیاسی در هر دو کشور، به پیشرفت و استیلا بر هوش مصنوعی بهعنوان یک ضرورت اقتصادی و نظامی آینده خود مینگرند.

دلیل این موضوع نیز ماهیت و طبیعت هوش مصنوعی است که آینده آن مملو از ابهاماتی جدی در رابطه با تولید سلاحهای قدرتمند و یا کاربرد این فناوری در صنایع است. زمانی که یک کشور به فناوری ماشینهای هوشمندی که مانند انسان فکر میکنند، دست پیدا کند، توانایی رقابت بالایی یافته و بهنوعی بقای خود را تضمین میکند.

در حال حاضر کشور چین بهطور رسمی، این هدف را بهعنوان استراتژی آینده خود معرفی کرده و قصد دارد مبالغ هنگفتی در این حوزه سرمایهگذاری کند. ایالاتمتحده امریکا نیز در حال برداشتن گامهایی جدی در حوزه پیشرفت هوش مصنوعی بوده و برای دستیابی به این هدف به توانایی بخش خصوصی و صنایع غیردولتی خود چشم دارد. این بخش بهطور خاص در سیلیکون ولی مستقر بوده و شامل شرکتهایی بزرگ مانند گوگل و مایکروسافت میشود.

بر اساس تعریف دانشمندان، هوش مصنوعی عبارت است از مجموعهای از ماشینهای پیشرفته و دارای هوش که بهطور بالقوه میتوانند جایگزین انسانها در تمامی کارها شوند. این امر باعث میشود که انسان از انجام کارهای روزمره معاف شود باید در نظر داشت که موضوع به همین سادگی نیست و در صورت تحقق این مسئله، بسیاری از بنیادهای اجتماعی دچار یک تحول و دگرگونی شدید شده و ممکن است زندگی برای انسان تبدیل به یک جهنم بیهدف و آزاردهنده شود.

ترجمه و گردآوری گزارش: احسان محمدحسینی

منبع: sciencefocus، livescience، hosted و sciencealert

جزئیات تازه از مرگ 6 کارگر در آتش سوزی شرق تهران

جزئیات تازه از مرگ 6 کارگر در آتش سوزی شرق تهران  انتظار

انتظار  همسر علی ضیا را می شناسید ؟! / حدس بزنید کیست ! + بیوگرافی و عکس عاشقانه!

همسر علی ضیا را می شناسید ؟! / حدس بزنید کیست ! + بیوگرافی و عکس عاشقانه!  جذاب ترین بازیگران سینما که کراش همه اند + 16 استایل ترند و مدلینگی که ایسنتاگرام را ترکاند!

جذاب ترین بازیگران سینما که کراش همه اند + 16 استایل ترند و مدلینگی که ایسنتاگرام را ترکاند!  ببینید | تصاویر تازه از رزمایش نیروی هوایی جمهوری آذربایجان در منطقه نخجوان

ببینید | تصاویر تازه از رزمایش نیروی هوایی جمهوری آذربایجان در منطقه نخجوان  نتایج آزمون استخدامی معلمان چه زمانی اعلام میشود؟

نتایج آزمون استخدامی معلمان چه زمانی اعلام میشود؟  کامرون به نتانیاهو: سپاه را به عنوان نهاد تروریستی شناسایی نمیکنیم

کامرون به نتانیاهو: سپاه را به عنوان نهاد تروریستی شناسایی نمیکنیم  واکنش حکیم به وتوی عضویت فلسطین در سازمان ملل توسط آمریکا

واکنش حکیم به وتوی عضویت فلسطین در سازمان ملل توسط آمریکا  چهره واقعی بهاره رهنما و الهام پاوه نژاد با پوشش نامتعارف//تولیدی

چهره واقعی بهاره رهنما و الهام پاوه نژاد با پوشش نامتعارف//تولیدی  واکنش اتحادیه اروپا به حادثه انفجار در اصفهان

واکنش اتحادیه اروپا به حادثه انفجار در اصفهان  تغییر تیپ و چهره دومین بازیگر نقش «نجلا» / محیا دهقانی جنجال کرد!

تغییر تیپ و چهره دومین بازیگر نقش «نجلا» / محیا دهقانی جنجال کرد!  دانلود آهنگ سلام فرمانده 3 ابوذر روحی

دانلود آهنگ سلام فرمانده 3 ابوذر روحی  کنایه معاون رئیسی به ادعای یک رسانه عربی

کنایه معاون رئیسی به ادعای یک رسانه عربی  عکس زن فوق جذاب احمد مهران فر + بیوگرافی و صفر تا صد خصوصی ترین ها

عکس زن فوق جذاب احمد مهران فر + بیوگرافی و صفر تا صد خصوصی ترین ها  این بازیگر دنیای شیرین بعد از 27 سال الان چه شکلی شده؟+ بیوگرافی اشکان اشتیاق

این بازیگر دنیای شیرین بعد از 27 سال الان چه شکلی شده؟+ بیوگرافی اشکان اشتیاق